06.19

【World MR News】デジタルスキャンの権利は誰にある? 「世界最大のxRカンファレンス AWE報告会!」レポートその①

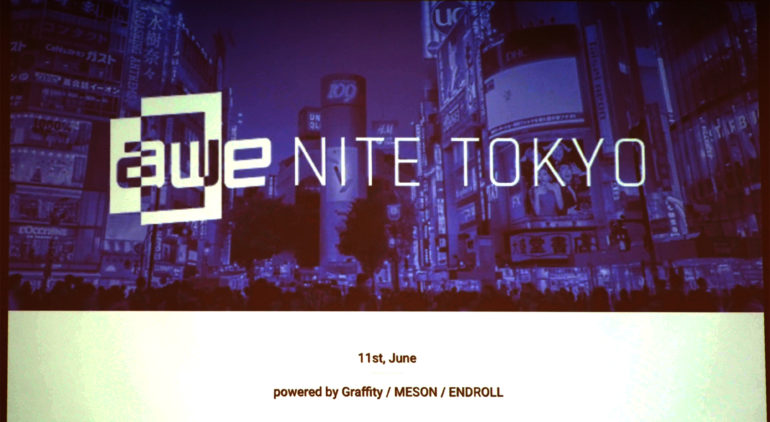

5月29日から31日の3日間、米国カリフォルニア州サンタクララで開催された世界最大のxRカンファレンス「AWE(オーグメンテッド・ワールド・エキスポ)」。AWEの支部活動である「AWE Niteの東京支部」立ち上げに伴い、運営メンバーが現地で視察してきた生の情報を共有するパネルディスカッション「世界最大のxRカンファレンス AWE報告会!」が、6月11日にYahooロッジで開催された。

この日のイベントは、Graffity Game Director 斉藤翔太氏、MESON CEO 梶谷健人、MESON COO 小林佑樹氏、ENDROLL COO 大島佑斗氏の4名が、それぞれのテーマごとに紹介するというスタイルで行われた。

▲写真左から、梶谷健人氏、斉藤翔太氏、大島佑斗氏。

▲今回は発表だけではなくファシリテーターの役割もはたしていた、“ARおじさん”こと小林佑樹氏。

本稿ではその中から、「AR Cloud」と「Startup」、「Smart Glass」の3つのセッションの模様をピックアップしてお届けする。

■「AR Cloud」に対する各社の取り組みとトレンド

AR Cloudには4つの構成要素がある。ひとつは、自己位置推定だ。これはデバイスがどこにあるのかを正確に把握する技術である。ふたつ目は、デジタルツインの作成・更新だ。物理法則までしっかりと再現された、もうひとつの世界をデジタルで作っていくことをさしている。

3つ目は永続的なコンテンツ保管だ。最近発表された『Minecraft Earth』のように、その場所に作ったものを残すことができるという要素である。4つ目は、カメラが人を見ているのか車などを見ているのかなど、何を見ているのか理解させるという技術だ。

AR Cloud構築には、「事前スキャン」「Edge SLAM」「SLAM+衛星情報」の3つのアプローチがある。「事前スキャン」は、ResonaiやSCAPEといた企業が取り組んでいるものだが、簡単にいうと事前にその場所の3Dモデルを作っておくというアプローチだ。あとは、それを画像認識でどこにいるのか判定していく。

精度は高くできるものの、事前に3Dマップを作っておく必要があるのが一番の課題である。そのため、Resonaiでは、エンタープライズ向けのオフィスなどをターゲットにしている。

「Edge SLAM」は、スマートフォンの端末上でリアルタイムにSLAM処理をして、Edgeで3Dメッシュを作成していくというアプローチだ。また、STURFEEという企業が取り組んでいるのが、GoogleマップのようなSLAMと衛星情報を組み合わせて、自己位置推定を行うというアプローチである。

この中で、技術的トレンドとして一番熱いのが「Edge SLAM」だ。6d.AI CEOのMatt Miesnieks氏は、Edge SLAMの優位性のひとつに、Edge上でメッシュ作成を完結させることで、プライバシーに配慮できるところを上げている。

カメラで撮影した生のデータをクラウド上に上げてから、セマンティックの処理をしてから3Dメッシュ化すると、クラウド上に不特定多数の顔のデータなどが残ってしまう。それをEdge側で処理することで、クラウドに上げるのはスクリーピングされたものだけになるのため、プライバシーに対して担保できるというわけである。

STURFEEは、衛星画像を元に自己位置推定をするため、事前スキャンが不要でいつでもその場でできるというのを強みに上げている。

各社の取り組みとしては、6d.AIは「AR Cloud版のAWSを目指している」と明言。Ubiquity6は、「よりクリエイターやデベロッパーに寄り添ったSDKを開発する」という方針を発表している。

AR Cloudを構築するときにデジタルレイヤーを作っていくことになるが、AWEではその権利が誰に帰属するのかということも、多くのセッションで議論されていた。

例えば、渋谷ヒカリエのAR Cloudのレイヤーを作ったときに、そこにコンテンツを表示する権利や広告の収益がフィジカルなオーナーに帰属するのか、デジタル側のクリエイターに帰属するのかという問題が出てくる。世界的にはまだこの議論の結論は出ていないが、ユニークなトピックとして紹介されていたのが、映画『スパイダーマン』とタイムズスクエアの判決である。

ソニー・ピクチャーズが映画『スパイダーマン』の中で、CGで作ったタイムズスクエアを登場させたのだが、その広告もソニー・ピクチャーズ側が現実とは異なる企業の広告を表示して、映画化している。それに対し、タイムズスクエア側が、そこはフィジカルな土地であるから権利の侵害であると訴えたのである。

論点は、デジタルコピーの権利がフィジカルなオーナーに帰属するのか、あるいはデジタルコピーの作成者に帰属するのかということだったが、裁判の結果、ソニー側が勝訴している。こちらはまだ最終的な結論は出ていないが、デジタルなスペースとフィジカルな建物の権利が分離しているというケースとして、今後紹介されることが多くなりそうだ。

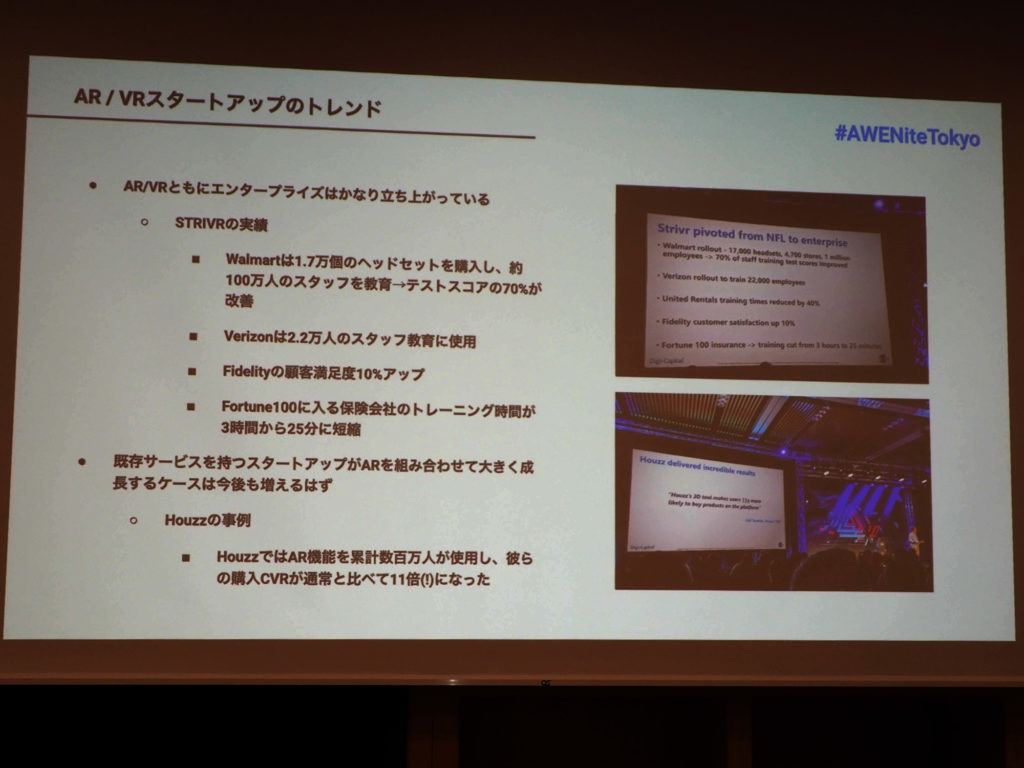

■AR/VRスタートアップ市場のトレンドは?

6d.AIなどにも出資しているNiko Bonatsos氏と6d.AI CEOのMatt Miesnieks氏のふたりの対談で語られていたのが、コンシューマー向けは時期尚早ということだった。それは、ウェアラブルが浸透するようなクールなハードがまだ登場していないからというのが理由だ。

とはいえ、エンタープライズもイケイケかというと、そういうわけでもない。ユースケースとテクノロジー、マーケットの3つを合わせ持っていないと、顧客を見つけることはできないという。

そうした中で、スタートアップに期待しているところとしては、未来を詳細に描いているところと、5~7年の長期戦を見据えて経営するということだ。海外のスタートアップも、人を採用したりハード開発に投資したりと、すぐにキャッシュアウトしてしまうケースが多い。

ここで話題に上げられていたのが、ハンドトラッキング技術を持つLeap Motionが、触覚フィードバック技術を持つUltraHapticsに買収された話だ。Niko氏が、Leap Motionの創業期にそのメンバーと話をしたときに、「初期の顧客はどういう人になる?」という問いかけに対して「僕たちの技術はすごいから、この業界にいる人全員がターゲットだ」と答えたことから、ビジネスとして成立しないと考え出資を見送っている。

その後、レイターステージになったときにもう1度会ったところ、同じ答えを返していた。Leap Motionは、ユースケースとマーケットがない、テクノロジーだけの会社であったため、買収されたのである。

今回のAWEには、メインホールのほかにスタートアップセクションも用意されていた。こちらは全体的にエンタープライズが多めだった。

AR/VRのトレンドとしては、エンタープライズは事業としてなりたっているところが増えてきている。BtoCのスタートアップでいきなり成功しているところはなかったが、既存のサービスを持ちユーザーベースとデータを持っている企業が、そこにARを組み合わせることで大きく成長するというケースが増えてきた。

Houzzは、米国で最も使われているインテリアや家具のマーケットプレイスだが、ARで家具をシミュレートするサービスをスマホアプリで提供したところ、累計数百万人のユーザーが使用している。そのCVRが、通常の人と比べて11倍にもなっているそうだ。

■ARサービスにおけるUI/UX

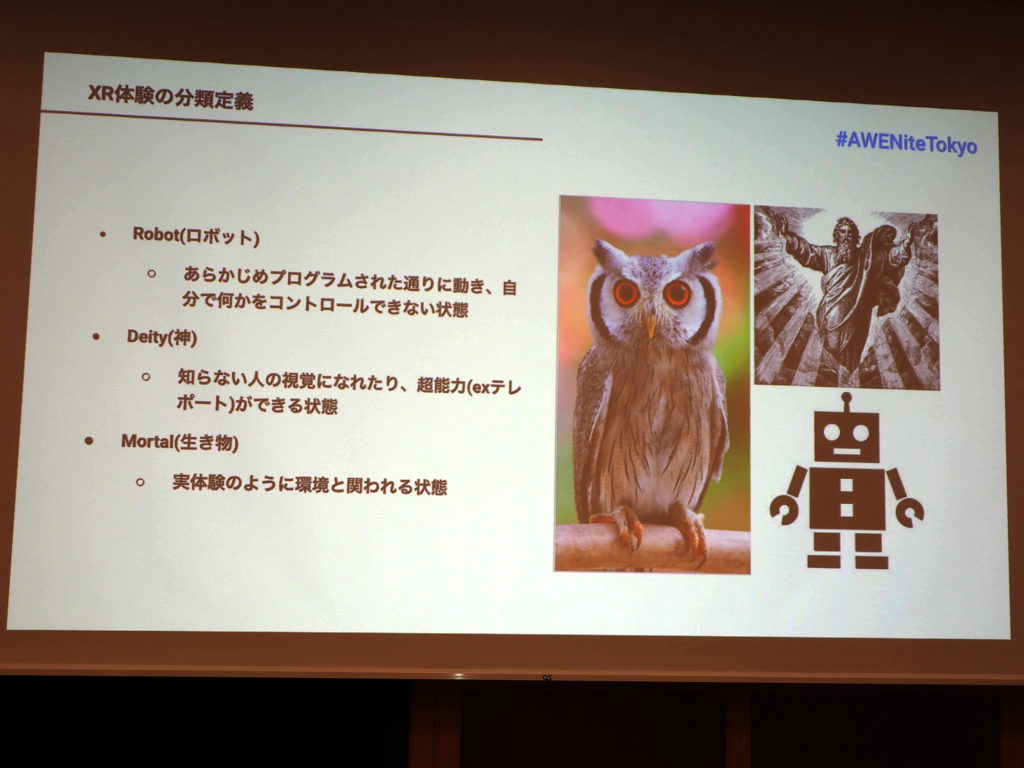

XR体験の分類の定義は、3つある。ひとつ目は視点で、これは1人称、2人称、3人称だ。ちなみに2人称とはマリオのように、自分を自分以外の視点から俯瞰してみる視点である。ふたつ目はビジュアルで、自分が見ている視点に身体があるかないかだ。3つ目は、外観との関わり方である。身体が見えていないパターンでは、自分が存在しない。自分が存在しても関われるものと関われないパターンがある。

これらを統合すると、XRの体験は主に3つの種類に分けることができる。ひとつ目は、「Robot(ロボット)」と呼ばれるパターンだ。あらかじめプログラミングされた通りに動き、何かを見ているような状態である。ふたつ目は、「Deity(神)」だ。こちらは、知らない人の視覚になれたり超能力のようなものが使えたりする状態である。3つ目は、「Mortal(生き物)」だ。こちらは、実体験のように環境と係わることができる状態である。

これらを理解した上でUI/UXを考えないと、気持ち悪くなってしまうので気を付けたほうがいいという。

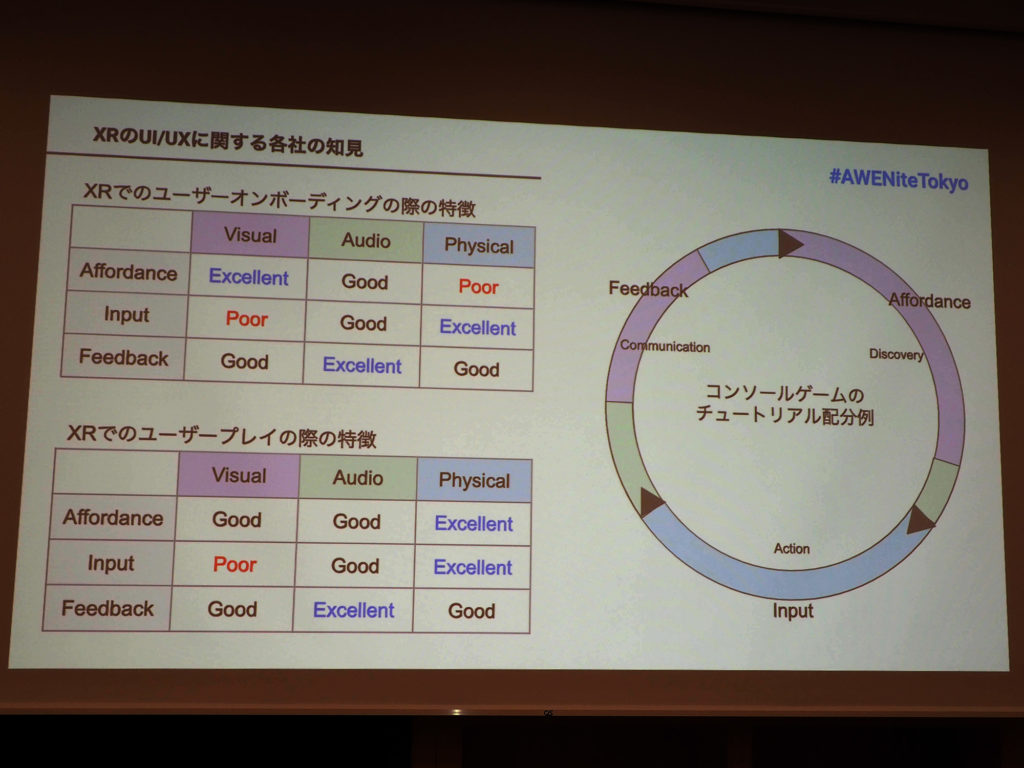

MODALITY(感覚要素)という言葉があり、5感以外の平衡感覚や内部知覚のようなものをまとめたものだ。その中で、XRで重要となるのは、視覚、聴覚、触覚である。それを、1分間でどれだけ人がどれだけの言葉を処理できるかWPM(Words Per Minute)で分けると、視覚が250~300、聴覚が150~160、触覚が125となる。

視覚は認識までの速度が速くカスタム性が高いが、間違いやすいというデメリットもある。聴覚は、360度どこから鳴っているのかわかりやすいので、後ろからアクションがあるときなどに認識しやすい。また、天の声のような第三者の声に従いやすい。デメリットしては、外国語だとわからないなど言語依存が高いなどがある。触覚は、認識の精度が高いため、触るとわかりやすい。一方、認識に時間が掛かるため疲れてしまうというデメリットもある。

コンソールゲームのチュートリアル配分例では、人が何かを出来ると思える感覚の「Affordance」と、機械に対して自分がどんなインプットをするのかの「Input」、その機械からのフィードバックの「Feedback」の3つに分類している。

「Affordance」に関しては、ビジュアルが多めでオーディオが付属している。「Input」ではコントローラーを触るフィジカルが多い。「Feedback」では、そのバランスを整えていくというのをベースに、コンソールゲームではUI/UXを定義している。

それをXRにしたときに、「Affordance」ではデザイナーは綺麗に整えようとするが、XRでは無理である。

GoogleのARチームが「Rapid Prototyping」というセッションを行っており、ARサービスを作るときに必ずラピッド・プロトタイピングが重要だという話をしていた。そこで語られていたのは、ARサービスを作る前に仕様を決めきるのは、AR/VRでは無理だから諦めろと断言していたという。

その理由は、普通のアプリやウェブと異なり、空間的・立体的な体験であるため実際に作ってみないといいか悪いかわからないからだ。その時に、高速でプロトタイピングをして作りながら解像度を上げていくラピッド・プロトタイピングの手法をチームの中に取り入れるのが重要なのである。

しかし、プロトタイプをすぐに開発してはいけないという話も出ていた。Googleのようなエンジニアが多い企業では、すぐに開発を始めていそうだが、どんなに素晴らしいエンジニアでもある程度時間が掛かってしまう。それよりも、Sketchで2DデザインしたものをPrincipleで動かしてみたり、レゴや紙のようなアナログなものを使ったりして時間をかけずにテストするところからスタートしている。

これぐらいの速いオペレーションでプロトタイピングを回し、角度が高くなってきてからUnityなどでプロトタイピングをして解像度を詰めていくほうがいいという。

それでは、プロトタイピングのゴールはどこになるのかという疑問が出てくるかもしれない。その時は終わりから始めるといいという。プロトタイピングによるトライ&エラーは、際限なくできてしまうが、最初に期限を決め手おき、その時点までの最適解を選択していくのだ。

Photo&Words 高島おしゃむ

コンピュータホビー雑誌「ログイン」の編集者を経て、1999年よりフリーに。

雑誌の執筆や、ドリームキャスト用のポータルサイト「イサオ マガジン トゥデイ」の

企画・運用等に携わる。

その後、ドワンゴでモバイルサイトの企画・運営等を経て、2014年より再びフリーで活動中。